Intelligenza Artificiale: L'IA Dovrebbe Essere Regolata Dal Governo?

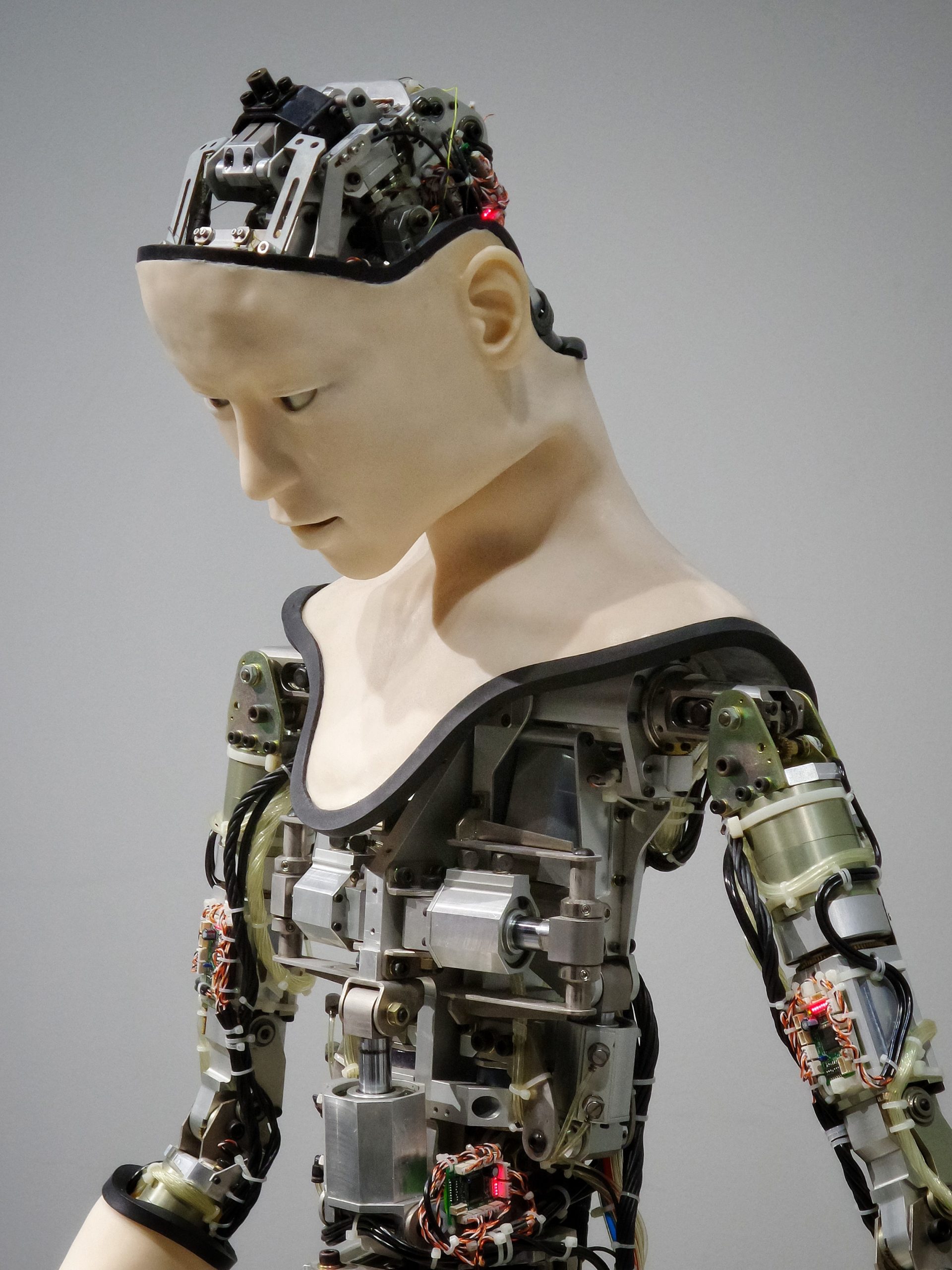

L’intelligenza artificiale sta cambiando le nostre vite: l’assistenza vocale come Siri, veicoli a guida autonoma e motori di ricerca che monitorano le nostre abitudini di navigazione. Questo è solo l’inizio di come l’IA cambierà la nostra vita quotidiana. Allora, che ruolo svolge il governo quando si tratta di intelligenza artificiale? E i responsabili politici dovrebbero regolamentare questa tecnologia all’avanguardia?

La risposta è naturalmente sì. L’intelligenza artificiale ha conseguenze sulla sicurezza e sull’equità, e quindi dovrebbe essere regolamentata per garantire sicurezza ed equità per tutti. I veri problemi risiedono su come regolamentarli, e chi sono gli attori legalmente responsabili.

Quali aspetti dell’ IA dovrebbero essere regolamentati?

Prima di tutto, se applichiamo la tecnologia IA alle persone dobbiamo assicurarci che i dati sono puliti, che non ci siano pregiudizi, che non ricreiamo gli stessi pregiudizi che esistono quando gli esseri umani esprimono giudizi. Ad esempio, un agente di polizia che fa una discriminazione in base al colore della pelle della persona fermata. Quindi dobbiamo stare molto attenti a non perpetuare le discriminazioni e i pregiudizi degli algoritmi che già abbiamo nella nostra società.

L’IA E LA DISCRIMINAZIONE

Un interessante esempio illustrativo di discriminazione dovuta all’IA e di questioni su come affrontare questa discriminazione sul punto di vista della giustizia è il recente caso della carta di credito di Apple. Apple ha rilasciato una nuova carta di credito, molto elegante con uno stile minimalista. Ma è anche una carta sessista. David Heinemeier Hansson si era lamentato del fatto che l’Apple Card gli aveva dato 20 volte il limite di credito che sua moglie aveva. In un tweet, Hansson ha detto che la disparità è stata nonostante sua moglie avesse un affidabilità finanziare migliore. Un’altra persona, il signore Wozniak, ha detto di avere lo stesso problema nonostante condivide con la moglie gli stessi conti bancari e beni. Apple si difende dicendo che non l’hanno fatto apposta, che è colpa dell’algoritmo.

Hanno identificato due spiegazioni diverse. Forse è dovuto al fatto che gli algoritmi sono stati sviluppati in un momento in cui il set di dati ha mostrato che le donne rappresentavano un rischio finanziario maggiore rispetto agli uomini. Una seconda o ulteriore spiegazione si basa sul modo in cui gli algoritmi vengono alimentati. Così, per esempio, non considerano che all’interno di una coppia sposata, l’uomo è più probabile di prendere un prestito a suo nome piuttosto che ai loro nomi comuni.

a anche se non lo hanno fatto intenzionalmente è comunque illegale. Così Apple dovrebbe cambiare algoritmo o migliorarlo, ma per ora non sappiamo cosa faranno. La domanda è: chi è il responsabile di questa discriminazione? È Apple? È il produttore di algoritmi? È l’algoritmo in sé, quindi nessuno? Questo caso solleva un altro problema: il problema della “black box”. Non possiamo determinare come gli algoritmi sono arrivati a questo giudizio. Questo solleva anche la questione della “esplicabilità” che spiegheremo in questo articolo.

PRIVACY & SPIEGABILITA’

In secondo luogo, ci sono due aspetti cruciali dell’IA che dovrebbero essere regolati, il primo è la privacy, il secondo è la “spiegabilità”.

- Privacy è ovvio per tutti. Dobbiamo proteggere la nostra privacy, è qualcosa che è intimo a noi. Tuttavia, il modo in cui queste tecnologie funzionano è che si basano su tutti i dati e anche sui dati che non pensiamo siano rilevanti. Quindi, avremmo bisogno di allentare ciò che consideriamo privato, in modo da poter ottenere il valore dato da questi dati. Tuttavia dobbiamo essere super consapevoli del fatto che dobbiamo avere severe linee guida sulla privacy in altri settori, e in particolare nel pericolo di sorveglianza dello stato.

- La “spiegabilità” è un aspetto più complesso. Il modo in cui queste tecnologie funzionano a livello avanzato, in particolare le artificial neural networks (ANN), i sistemi di deep learning, mostrano un altissimo grado di opacità perché non sappiamo perché o come sono arrivati a una particolare risposta. Di conseguenza, dobbiamo decidere se accettare la risposta anche se non sappiamo come è stata determinata, o se non siamo disposti ad accettare la risposta se non sappiamo il perché. Nel caso dell’assistenza medicale, noi come società non possiamo negare l’uso dell’IA, perché significherebbe negare l’assistenza medicale alle persone malate solo perché ci rifiutiamo di utilizzare soluzioni di IA se non cappiamo come sono arrivati alla soluzione. Sarebbe eticamente sbagliato. Quindi forse dovremo accettare il fatto che non avremo assoluta causalità del perché l’algoritmo ha preso la sua decisione, perché è un’alternativa migliore che rifiutare di salvare la vita delle persone. La sfida sarebbe quella di creare sistemi interpretabili dagli umani che non implichino il sacrificio delle prestazioni.

REGOLARLA

Oltre a ciò, dobbiamo regolamentare le autorità di regolamentazione, dobbiamo assicurarci che il governo abbia strutture e vincoli sul modo in cui utilizzano le informazioni registrate attraverso l’IA. Dobbiamo creare norme giuridiche. Cosi, quando le strutture giuridiche e i governi dovrano accedere ai dati lo potranno fare sotto alcuni condizioni, ma in altri casi non saranno autorizzati a utilizzarli a meno che non vi sia una ragione davvero importante, riconosciuta dalla giustizia. Al fine di non riprodurre gli stessi sistemi di sorveglianza e potere statale della Germania o del Giappone nel XX secolo con l’AI al giorno d’oggi.

I governi stanno facendo abbastanza per mettere in atto queste garanzie?

Il governo è molto indietro su questo tema. Stanno ancora lavorando alla regolamentazione dell’ Internet. E una volta che i governi inizieranno finalmente ad affrontare questi problemi, dovremo pensare anche a norme internazionali sull’IA.

Alcuni si chiedono anche se la regolazione dell’Intelligenza Artificiale sarà davvero possibile.

Fonte immagine:

Aggiungi qui il testo dell'intestazione

Nei nostri precedenti articoli abbiamo anche parlato di Netiquette, del Perché è importante avere un sito web, delle tecniche del SEO, Social Media Marketing, di 7 consigli indispensabili per la crescita della tua attivita’ e di Linkedin per le aziende.